CAIR多项医学人工智能成果将在MICCAI 2024大会发布

发表日期: 2024年7月31日

EARTH Workshop网页链接:https://earth-workshop.github.io/

论文一:EchoMEN: Combating Data Imbalance in Ejection Fraction Regression via Multi-Expert Network

作者:Song Lai, Mingyang Zhao, Zhe Zhao, Shi Chang, Xiaohua Yuan, Hongbin Liu, Qingfu Zhang, Gaofeng Meng

链接:https://github.com/laisong-22004009/EchoMEN

心脏射血分数(Ejection Fraction,EF)是评估心脏功能的重要指标,对于心力衰竭的诊断至关重要。现有算法可通过超声心动视频自动估算射血分数,但由于临床数据中正常射血分数的样本量远多于异常样本,导致算法对正常群体的过拟合,这对患者的健康诊断和治疗计划制定构成了挑战。

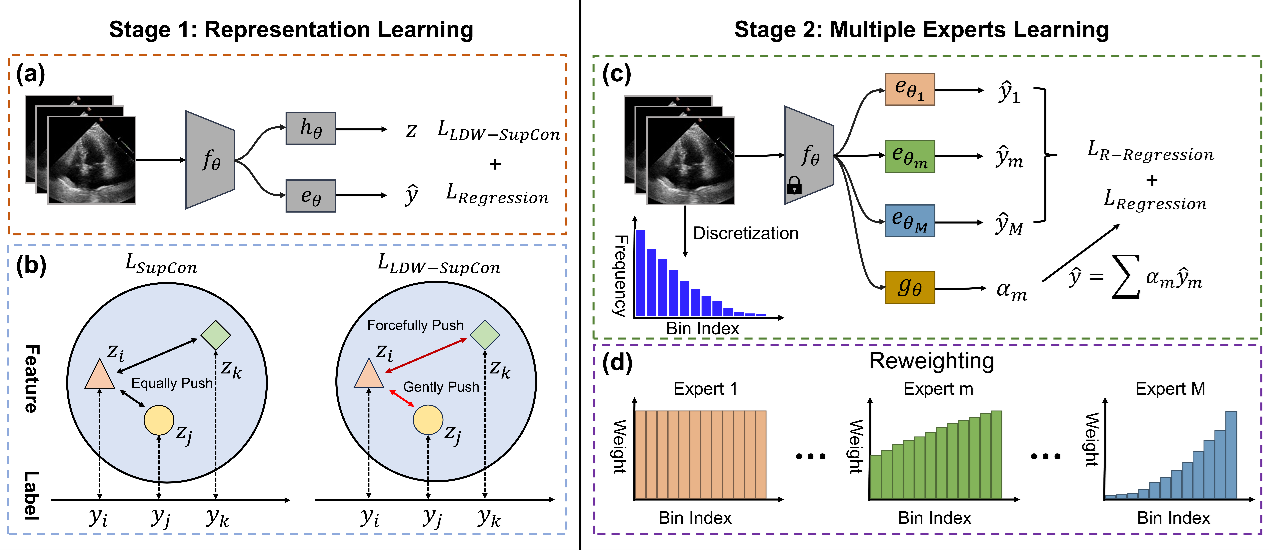

为了解决这一问题,研究人员提出了一种多专家网络模型EchoMEN,旨在通过集成学习来解决EF回归中的数据不平衡难题。CAIR博士生赖嵩介绍说,EchoMEN采用了两阶段解耦的训练策略。第一阶段引入了标签距离加权监督对比损失函数,通过考虑负样本对标签的距离关系,增强了模型表示学习能力。第二阶段训练了一个多专家模型,各个专家头专家学习EF值的不同区域,以平衡地处理不同的患者群体。

在现有的最大规模的EchoNet-Dynamic数据集上的实验结果表明,EchoMEN模型在整体EF预测准确率上超过了现有的所有方法,尤其在心力衰竭的两个少数类别HFrEF(EF<40%)和HFmrEF(40%≤EF<50%)上取得了最佳表现,且在多数类别HFpEF(EF≥50%)上与SOTA方法持平,实现了全面平衡的预测性能。

EchoMEN是首个专门针对心脏EF回归不平衡问题并提升诊断公平性的工作,对于辅助医生做出更精准的诊断具有重要意义。

论文二:Transforming Surgical Interventions with Embodied Intelligence for Ultrasound Robotics

作者:Huan Xu, Jinlin Wu, Guanglin Cao, Zhen Chen, Zhen Lei, Hongbin Liu

链接:https://arxiv.org/abs/2406.12651

超声成像已经彻底改变了非侵入性诊断方法,在许多医学领域显著改善了患者的治疗效果。然而,将超声技术与机器人系统集成以实现自动扫描仍面临挑战,包括指令理解和动态执行能力的限制。

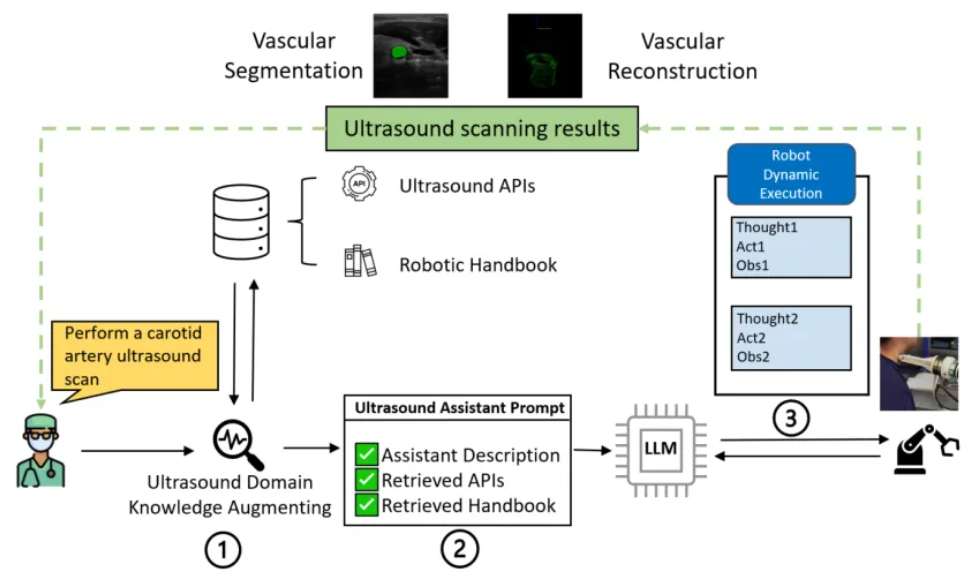

为了应对这些挑战,研究人员开发了一种创新的超声影像具身智能系统,将超声机器人与大语言模型相结合,提高了超声机器人的智能水平和操作效率。该系统采用了双重策略:首先,将大语言模型与超声机器人集成,通过理解超声领域的知识(包括API和操作手册),将医生的口头指令转化为精确的运动规划;其次,采用动态执行机制,根据患者的移动或操作错误实时调整扫描计划。

CAIR工程师许欢解释道,该系统显著提高了超声扫描的效率和质量,为进一步发展自主医疗扫描技术奠定了基础。

论文三:Force Sensing Guided Artery-Vein Segmentation via Sequential Ultrasound Images

作者:Yimeng Geng, Gaofeng Meng, Mingcong Chen, Guanglin Cao, Mingyang Zhao, Jianbo Zhao, Hongbin Liu

链接:https://github.com/evelynskip/artery-vein-segmentation

在超声引导的血管检查和介入手术中,动脉和静脉的准确分割至关重要,能帮助医生精确识别目标血管,并最小化相邻结构的意外损伤的风险。然而,由于动脉和静脉形态上相似,现有的技术难以实现精确分割。

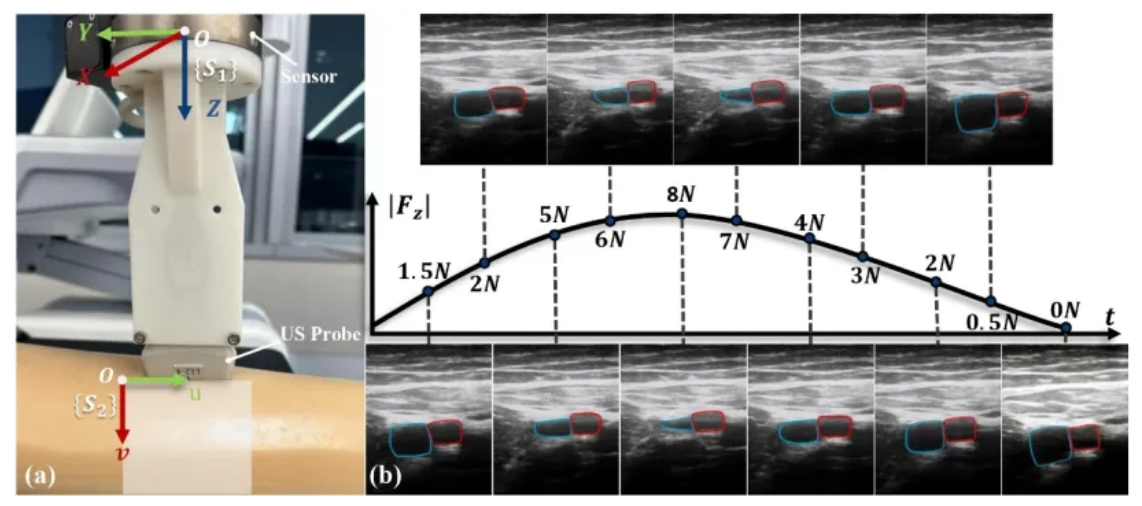

为了解决这个问题,研究人员提出了一种力传感引导的分割方法神经网络框架,利用接触力数据精确分割动脉和静脉。CAIR博士生耿艺萌介绍道,在临床实践中,医生通常通过按压患者的皮肤并观察超声影像中血管的变形程度来区分动脉和静脉。在这个过程中,动脉在压迫下几乎不变形,而静脉则发生显著变形,甚至可能完全闭塞。该算法由此获得启发,利用力的大小来识别一系列超声图像中具有最显著血管变形的关键帧。继而通过注意机制将这些关键帧与当前帧融合,利用不同的形变程度来分割动静脉。该力触感引导框架可以无缝地集成到各种分割网络中,最高实现了75.63%MIoU的分割性能。同时,科研人员创建了包含三千张血管图像与相应的力数据的超声动静脉数据集Mus-V,这也是已知的首个多模态超声血管数据集。

论文四:PANS: Probabilistic Airway Navigation System for Real-time Robust Bronchoscope Localization

作者:Qingyao Tian, Zhen Chen, Huai Liao, Xinyan Huang, Bingyu Yang, Lujie Li, Hongbin Liu

链接:https://arxiv.org/abs/2407.05554

支气管镜介入是检查和诊断气道病变的基本工具。在检查中,医生使用配有摄像头的柔性内窥镜,探查支气管分支,导航到肺部外围和结节。然而,支气管镜的视野有限,需要丰富的临床经验才能在气道中准确定位。

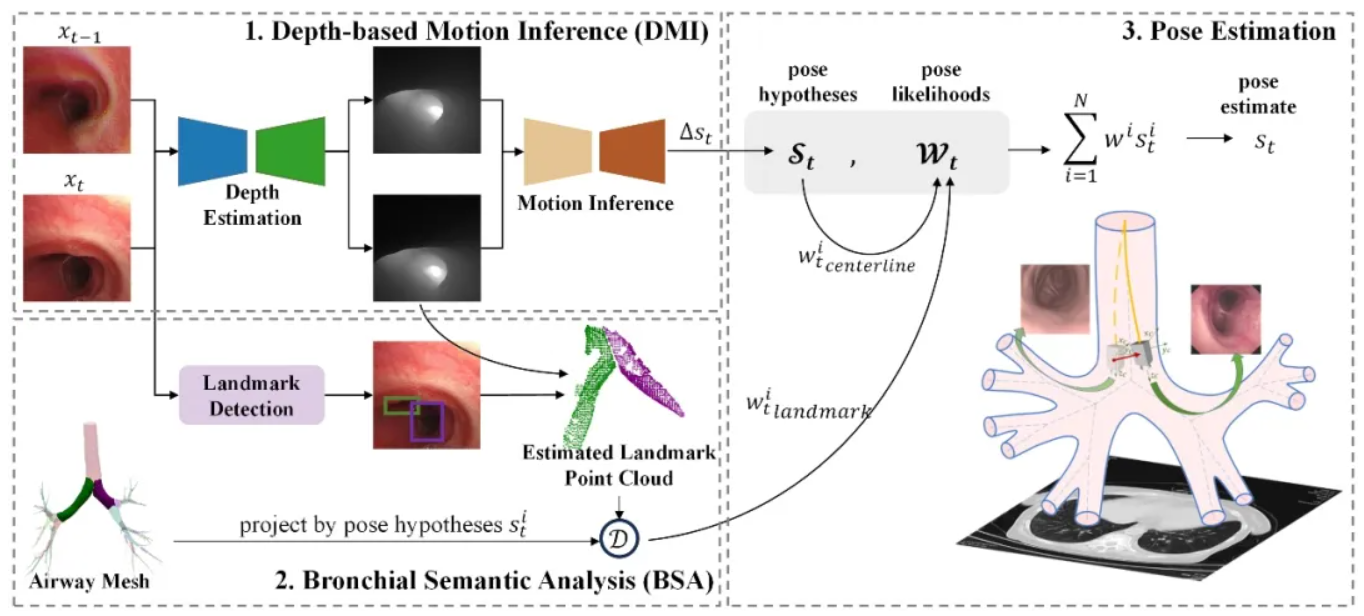

为了解决支气管镜定位的挑战,研究团队开发了概率气道导航系统(PANS),旨在通过多种视觉信息集成来增强定位的鲁棒性。PANS采用了蒙特卡罗框架,模拟经验丰富的外科医生的综合视觉方法,跟踪支气管镜的位置。为了实现在各种病例中的实时应用,科研人员构建了一个容纳31名病例的数据库,包含不同健康状况病人的胸肺CT及气管镜录像,以优化轻量级神经网络进行深度估计、运动推理和地标检测。通过与现有的先进方法进行的对比评估,展示了PANS在真实临床数据集上的卓越性能,在全气管镜导航中仅有8.7mm的定位误差,与其他方法相比误差降低了42.4%。负责项目研发的田庆瑶指出,PANS系统通过整合多种视觉信息,提高了支气管镜定位的鲁棒性和精度。这一突破将有助于克服现有视觉导航技术在临床应用中的障碍,为支气管镜检查提供更可靠和实时的定位支持。